Tehnologiile de inteligenţă artificială (AI) pot genera imagini medicale foarte greu de deosebit de cele reale, ceea ce ridică probleme serioase legate de siguranţa utilizării acestor date şi de credibilitatea diagnosticului medical. Un studiu arată că aceste imagini pot fi confundate cu cele autentice de medici şi pot induce în eroare chiar şi sistemele automate de analiză.

Imaginile radiologice generate de AI, concepute să imite radiografiile reale ale pacienţilor, pot induce în eroare atât radiologii cu experienţă, cât şi instrumentele bazate pe inteligenţă artificială, arată un studiu publicat, marţi, în revista Radiology. Rezultatele evidenţiază riscul de manipulare intenţionată a datelor medicale.

În acest studiu, 17 radiologi din 12 spitale din şase ţări au analizat 264 de radiografii. Jumătate dintre imagini au fost generate cu ajutorul unor instrumente de AI, inclusiv ChatGPT şi RoentGen. Când participanţii nu au fost informaţi despre scopul real al cercetării, doar 41% dintre imaginile false au fost identificate corect.

După ce radiologii au aflat că setul de date conţine imagini artificiale, acurateţea medie în diferenţierea radiografiilor reale de cele generate de AI a crescut la 75%. Rezultatul sugerează că radiologii identifică mai uşor imaginile false atunci când ştiu dinainte că acestea pot fi prezente în setul analizat.

Autorul principal al studiului, dr. Mickael Tordjman, de la Icahn School of Medicine - Mount Sinai, din New York, avertizează că realismul acestor imagini creează vulnerabilităţi importante. De exemplu, o fractură falsă ar putea fi imposibil de diferenţiat de una reală, ceea ce ar putea fi exploatat în litigii medicale.

De asemenea, există riscuri de securitate informatică. Dacă persoane rău intenţionate ar obţine acces la reţeaua unui spital, ar putea introduce imagini sintetice pentru a influenţa diagnosticul pacienţilor sau pentru a afecta funcţionarea sistemelor clinice, subminând încrederea în dosarele medicale digitale.

„Studiul nostru arată că aceste radiografii false generate cu inteligenţă artificială sunt suficient de realiste încât să inducă în eroare chiar şi radiologii, adică medicii specializaţi în interpretarea imaginilor medicale, chiar şi atunci când ştiau că în setul analizat există imagini generate de AI”, a declarat dr. Tordjman, citat într-un comunicat al Societăţii de Radiologie din America de Nord (Radiological Society of North America - RSNA.

„Acest lucru creează o vulnerabilitate majoră în context juridic, deoarece, de exemplu, o fractură inventată ar putea fi imposibil de deosebit de una reală. Există şi un risc important de securitate informatică: dacă persoane rău intenţionate ar obţine acces la reţeaua unui spital, ar putea introduce imagini false pentru a influenţa diagnosticele pacienţilor sau pentru a provoca disfuncţionalităţi la scară largă, prin afectarea credibilităţii dosarelor medicale digitale”.

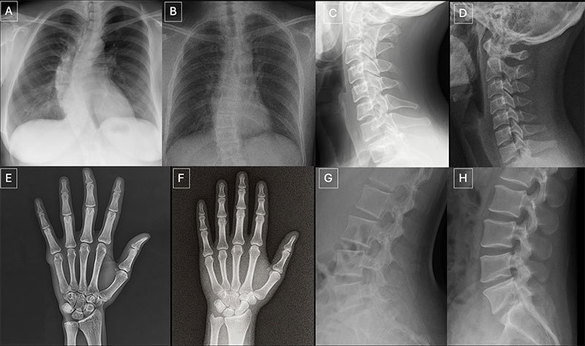

Radiografii reale şi radiografii generate de GPT-4o, pentru aceleaşi regiuni anatomice: (A) radiografie toracică postero-anterioară reală şi (B) generată de GPT-4o, (C) radiografie reală a coloanei cervicale în incidenţă laterală şi (D) generată de GPT-4o, (E) radiografie reală a mâinii în incidenţă postero-anterioară şi (F) generată de GPT-4o, precum şi (G) radiografie reală a coloanei lombare în incidenţă laterală şi (H) generată de GPT-4o. Perechile arată că GPT-4o poate produce imagini radiologice plauzibile pentru diferite regiuni anatomice. Credit: RSNA, 24 martie, 2025

Studiul a evaluat şi capacitatea unor modele lingvistice mari de a detecta imaginile false.

Acurateţea a variat între 57% şi 85% pentru modelele GPT-4o (OpenAI), GPT-5 (OpenAI), Gemini 2.5 Pro (Google) şi Llama 4 Maverick (Meta). Nici măcar modelul GPT-4o, care a fost folosit pentru generarea imaginilor, nu a reuşit să le identifice pe toate, deşi a avut cele mai bune rezultate dintre modelele testate.

Cercetătorii subliniază necesitatea unor măsuri de protecţie digitală care să permită diferenţierea între imagini reale şi artificiale şi să prevină manipularea datelor. Printre soluţiile propuse se numără utilizarea unor marcaje invizibile care să ateste originea imaginilor.

Potrivit autorilor, riscul ar putea creşte odată cu apariţia imaginilor false pentru alte tipuri de investigaţii, precum tomografia computerizată sau rezonanţa magnetică. În acest context, dezvoltarea unor seturi de date pentru instruire şi a unor instrumente de detectare este considerată esenţială încă din această etapă.